改變世界的聊天框,ChatGPT 是怎樣被造出來的?

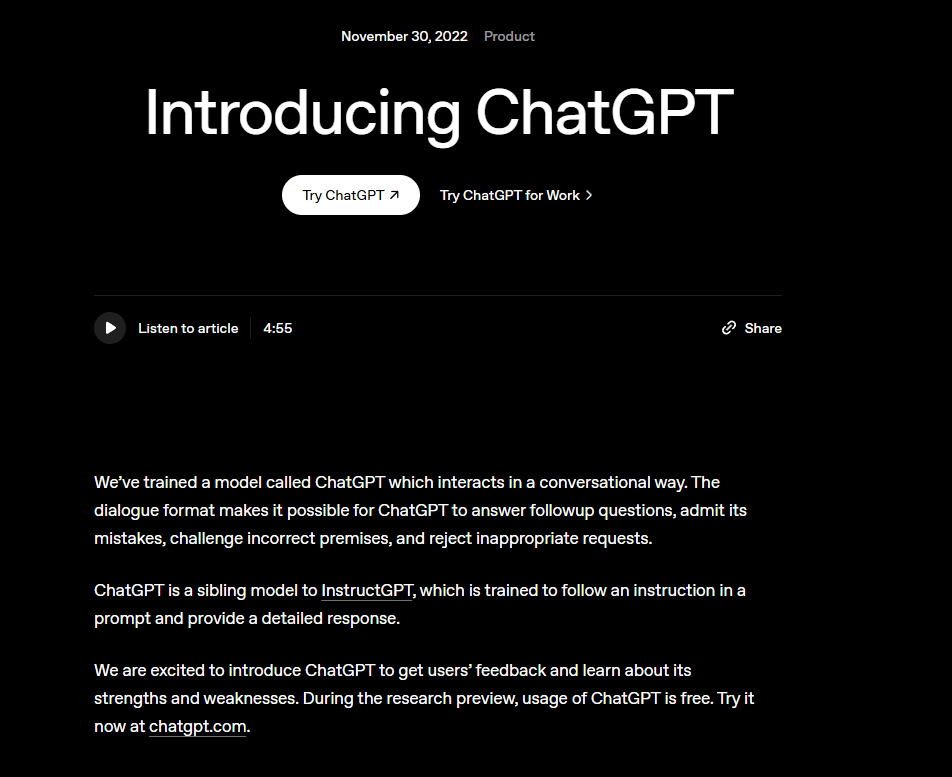

2022 年底,很多人第一次打開 ChatGPT 時,都會有一種很奇怪的感覺。

它不像搜索引擎,也不像語音助手,更不像過去那些一問一答、聊兩句就索然無味的聊天機器人。你問它一個問題,它能答;你嫌它講得不夠清楚,它能繼續解釋;你讓它換一種語氣,它真的會換;你指出它錯了,它甚至還會順著你的意思重寫一遍。

也是從那一刻起,AI 才開始真正從論文、實驗室和科技新聞裡走出來,變成普通人手邊可以直接使用的東西。很多人後來回憶起第一次使用 ChatGPT 的體驗,都會用到一個很相似的詞:震撼。

這種震撼當然來自模型能力,但又不只是模型能力。

因為真正值得追問的問題,從來不是 ChatGPT 為什麼這麼強,而是:為什麼那麼多早就存在的技術,偏偏在 2022 年,突然長成了 ChatGPT 這個樣子?

先說結論。

ChatGPT 不是某個天才團隊在一夜之間發明出來的產品。它更像是四條技術路線於同一時刻交匯的結果:Transformer 打開語言模型上限,規模化訓練逼出能力躍遷,人類反饋訓練把模型調成助手,而一個看似簡單的聊天框,則把這一切轉變成普通人能立刻上手的產品。

換句話說,ChatGPT 的爆發,不只是一次模型升級。

它更是一次技術、工程和產品判斷同時到位後的結果。

ChatGPT 的起點,不是聊天,而是 Transformer

很多人第一次接觸 ChatGPT,會很自然地把它理解成一個特別聰明的聊天機器人。

但這其實低估了它。

ChatGPT 的前史,不是從聊天開始的,而是從大語言模型的底層架構開始的。

2017 年,Google 提出 Transformer 架構。放到今天看,這幾乎是整個大模型時代最關鍵的起點之一。該架構完全基於注意力機制,徹底摒棄遞歸和卷積結構,從而顯著提高模型的並行性和訓練效率。

它最重要的意義在於,它不只是讓模型訓練效果更好,而是讓把模型繼續做大這件事成為可能。

這是一個聽起來沒那麼戲劇化、但影響卻極其深遠的轉折。

在那之前,機器當然也能處理語言,也能做翻譯、問答、文本生成,但它們很難被統一到一條足夠強、足夠大的技術路線裡。Transformer 的出現,相當於給後來的 GPT 系列、大語言模型、乃至 ChatGPT,搭好一根真正能承重的主樑。

它沒有直接發明「對話」。

但它讓後來的一切,第一次有了長出來的土壤。

如果沒有 Transformer,後來的 ChatGPT 很可能不會是今天這個樣子。它不會這麼大,不會這麼通用,也不會這麼像一個幾乎什麼都能聊兩句的工具。

真正讓行業興奮的,是 GPT-3 證明了一件事:規模真的會出奇蹟

Transformer 解決的是能不能做大的問題。

而 GPT-3 解決的,是做大之後會發生什麼的問題。

2020 年,OpenAI 推出 GPT-3。1750 億參數,這在當時是一個天文數字。但真正讓行業震動的,不只是它有多大,而是它表現出來的通用性。同一個模型,不經過專門微調,就能夠在翻譯、問答、改寫、代碼生成等各種任務裡給出像樣的結果。

GPT-3 論文將這種能力概括為 few-shot / in-context learning。

Language Models are Few-Shot Learners

這件事的意義,遠不止模型更強了。

它改變了人們對 AI 的想象。

在 GPT-3 之前,很多人對 AI 的理解,仍然停留在為每個任務做一個模型。翻譯有翻譯模型,推薦有推薦模型,語音識別有語音識別模型,大家習慣了讓模型在單點任務上變強。

GPT-3 則給出了一個截然不同的答案:也許你不需要先把世界拆成無數個小任務,再一個個教會模型。也許你只需要先訓練出一個足夠大的通用模型,它自己就會在規模擴張的過程中,長出許多以前只能靠專門系統完成的能力。

也是在那個階段,Scaling Laws 開始被越來越多人當成行業共識。

OpenAI 在 Scaling Laws for Neural Language Models 中指出,模型規模、數據規模和算力提升會帶來可預測的性能改善,而這種改善在很大範圍內呈冪律趨勢。

Scaling Laws for Neural Language Models

回頭看,GPT-3 之所以重要,不只是因為它很強。

而是因為它讓整個行業第一次真正相信:通往更強 AI 的道路,也許真的可以靠繼續把模型做大來打開。

GPT 到 ChatGPT,中間差的不是更大,而是更「聽人話」

問題也恰恰出現在這裡。

GPT-3 很強,但它並不好用。

它能寫出驚豔的句子,也能在許多任務上給出超出預期的結果。但它同樣會跑題,會誤解指令,會一本正經地胡說八道。很多時候,你不是在使用它,更像是在試探它、猜它、適應它。

它更像一臺能力強大的語言引擎。

但還不像一個真正能配合你的助手。

這就是 ChatGPT 出現之前,最關鍵的一道門檻。

OpenAI 後來補上的,並不是讓模型更大,而是讓模型變成人類想要的工具。這背後的核心,就是 InstructGPT,以及 RLHF,也就是人類反饋強化學習。

InstructGPT 論文明確指出,單純把語言模型做大,並不會天然提升它遵循用戶意圖的能力。

Training language models to follow instructions with human feedback

這個思路說起來並不複雜。

先讓人類寫出更理想的回答,再讓人類去比較不同回答哪個更好,最後再用這些偏好去反過來訓練模型。模型慢慢學到的,不再只是語言應該怎麼接,而是人類到底更喜歡怎樣的回答方式。

看上去只是把味道調順了一點。

其實不是。

這是一次角色變化。

從這一刻開始,模型的目標不再只是生成一段合理文字,而是儘可能去理解人的意圖、配合人的需求、順著人的工作方式往下走。

這是 GPT 到 ChatGPT 之間,最重要的一步。

參數決定了能力上限。

對齊決定了可用下限。

會說,不等於會幫你。

而 ChatGPT 的關鍵突破,恰恰就在「幫你」這兩個字上。

真正改變世界的,也許不是模型,而是那個聊天框

技術走到這裡,其實還不夠。

AI 行業從來不缺驚豔的論文,也不缺實驗室裡的演示。真正稀缺的,是一種能讓普通人立刻理解、立刻上手、立刻感到這東西有用的產品形態。

而 ChatGPT 在 2022 年爆發,一個被低估的原因就是:

OpenAI 給它套上了一個最樸素、卻也最強大的產品外殼——聊天框。

沒有開發者後臺,沒有複雜設置,沒有專業門檻,沒有一大堆需要預先學會的操作邏輯。

你只需輸入一句話。

剩下的,它來接。

這個動作看上去太簡單了,簡單到容易讓人忽略它的重要性。

你不需要懂 Transformer,不需要懂參數規模,不需要懂強化學習,甚至不需要知道「大語言模型」這五個字是什麼意思。你只需要像平時說話一樣,把問題丟給它。

它接住了。

這也是為什麼,很多人第一次被 ChatGPT 震住時,不是看懂了論文,不是瞭解了 benchmark,更不是科技媒體告訴你「新時代來了」。

而是那個瞬間太直接了。

你對著一個聊天框說一句話,它真的順著你的意思往下走了。

它不是簡單返回一個結果。

它是在參與。

這才是 ChatGPT 最像被髮明出來的地方。

後來的升級,補齊的不是魔法感,而是工具感

如果說 2022 年的 ChatGPT 最吸引人的地方,是它像魔法。

那麼之後幾代模型的工作,就是把這種魔法慢慢磨成工具。

GPT-4 帶來的,不只是答案更漂亮,也不只是文風更成熟。它補齊的是複雜任務裡的穩定性,是更強一點的推理能力,是在更多場景下的可靠性。

GPT-4 技術報告裡把 GPT-4 模型定義為可接受圖像與文本輸入,輸出文本的大規模多模態模型,這標誌著 ChatGPT 開始從「會聊天」走向「更能處理複雜任務」。

再往後,多模態成為新方向。

模型不再只處理文字,也開始看圖、聽聲音、做更自然的互動。

OpenAI 在 GPT-4o 發佈頁中把它描述為文本、圖像與音頻能力更原生地融合在一起的模型,這也進一步說明,ChatGPT 想做的不只是一個文本聊天機器人,而是一個更通用的數字接口。

它會寫,會看,會聽,會調用工具,會進入人的工作流程。

它不再只是回答問題。

它開始試著幫人做事。

從這個意義上說,ChatGPT 後來的升級,並不是單純為了讓它更像人,而是為了讓它更像一件耐用的工具。

更強的推理,是為了少犯錯。

更長的上下文,是為了處理更完整的任務。

多模態能力,是為了不只活在文本世界裡。

過去的軟件,需要人去學習它的用法。

現在的大模型工具,開始反過來學習人的語言。

這不只是產品的變化。

這是人與工具關係的變化。

而這種關係,直到今天,我們可能都還沒有適應完。