Anthropic CEO:Scaling 會繼續、AGI 兩年內到來、最擔心的不是 AI 失控而是人類濫權

如果要找一個人來解釋「AI 安全」到底是什麼、為什麼重要、以及它和「讓 AI 變得更強」之間為什麼不矛盾,Dario Amodei 無疑是最合適的人選。

十年前在百度跟著吳恩達做語音識別,最早一批押注「把模型變大就行」的異端分子。後來在 OpenAI 主導了 GPT-2、GPT-3 和 RLHF 的研究方向,然後帶著一群人出走,創立 Anthropic,造出了 Claude,在最新的公告中宣稱公司年化收入已達 300 億美元,比自己的老東家 OpenAI 還高出了 50 億美元。

這個人身上最反直覺的地方在於,他是 AI 行業裡最大聲談論風險的 CEO,同時也是最堅定的 Scaling 信徒。他不覺得這兩件事矛盾,反而認為它們是同一枚硬幣的兩面。

最近,知名播客主持人 Lex Fridman 對 Dario Amodei 進行了近三小時的深度專訪。

這是 Dario Amodei 迄今為止最完整、最坦誠的一次公開表達,一個同時拿著油門和剎車的人,試圖向你解釋這兩個踏板為什麼必須同時存在。

過去十年,Scale 幾乎每次都贏了

採訪開篇,Fridman 直接切入 Scaling Laws。Dario 從自己的親身經歷講起。

2014 年他加入百度 AI 實驗室,作為一個新人,做了一件極其簡單的事:把語音識別的神經網絡變大、數據喂多、訓練久一點。結果模型就是越來越好。

「當時所有人都在說『我們還沒找到正確的算法』『還沒破解人腦的奧秘』。但我就是個新手,我看著這些旋鈕,模型大小、數據量、訓練時長,然後一個一個擰。結果就是越擰越好。」

2017 年,GPT-1 的結果讓他徹底確信:語言是可以無限 scale 的領域。幾萬億詞的語料,配上越來越大的模型,能力就會持續增長。

Ilya Sutskever 當時對他說了一句話,Dario 說這句話解釋了他見過的一千個現象:「你需要理解的是,這些模型只是想學習。」

有人說,模型只能學句法,學不會語義;

有人說,句子能寫通順,段落絕對不可能;

現在又變成了「數據快耗盡了」「模型不會真正推理」。

Dario 說,這些阻礙過去一直在出現,但 scale 也一次又一次找到了繞過去的方法。

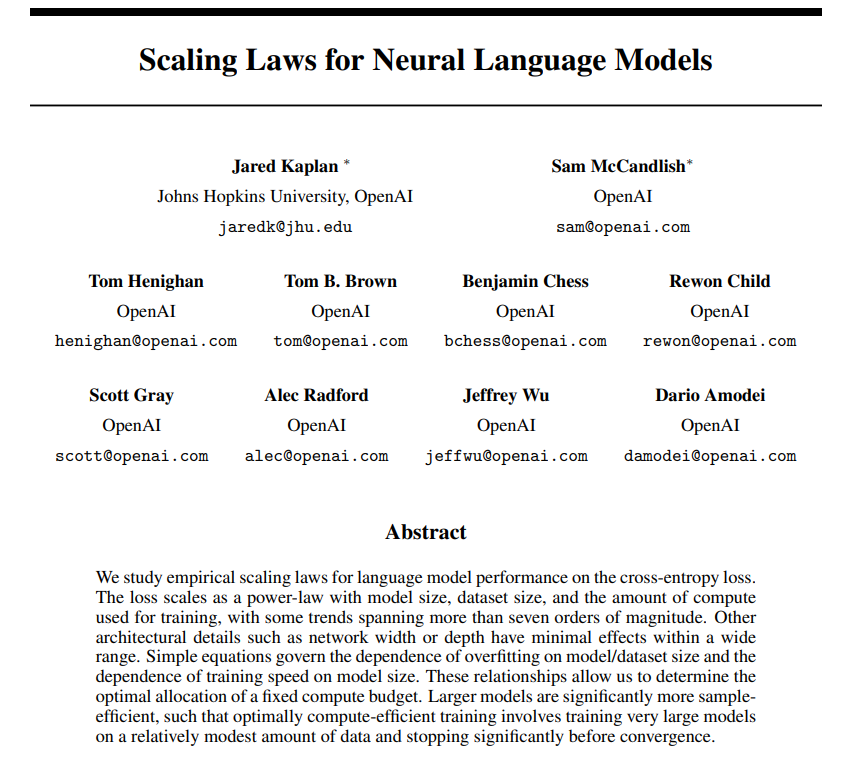

Scaling Laws for Neural Language Models

「我現在的立場是:我們只有歸納推理來支撐未來兩年會像過去十年一樣。但我已經看過太多次這個劇本了,我真的相信 scaling 會繼續下去。它有某種我們在理論上還無法解釋的魔力。」

Claude 為什麼有時候「變笨了」?

Fridman 拋出了一個 Reddit 經典問題:用戶老覺得 Claude 越用越笨,這是怎麼回事?

Dario 首先澄清:模型的權重,也就是模型的「大腦」,在沒有發佈新版本的情況下是不會改變的。

「隨便換權重在推理層面就很難操作,而且你改一個東西會連帶改一百個東西。」

他承認有兩種例外:發佈前的小規模 A/B 測試,以及偶爾調整系統提示詞。但這些都很少發生,而用戶的抱怨卻是持續不斷的,不只針對 Claude,GPT-4 也一樣。

他給出的理論是:模型對措辭極度敏感。你昨晚問「做任務 X」和今早問「你能做任務 X 嗎」,得到的結果可能截然不同。再加上心理適應效應,新模型剛出來時覺得驚豔,用久了就只看到缺點。

「就像飛機上第一次有 Wi-Fi 時覺得是魔法,現在連不上就覺得是垃圾。」

「Certainly」評估和打地鼠困境

談到 Claude 的性格塑造,Dario 坦承這是一場永無止境的打地鼠遊戲。

曾經有一個版本的 Claude 瘋狂說「Certainly」,「Certainly, I can help you with that. Certainly, I would be happy to do that.」。

為此團隊專門做了一個「Certainly 評估指標」來追蹤這個毛病。但問題是,你修好了「Certainly」,它可能就開始說「Definitely」。

更深層的矛盾是:你想讓模型少廢話,結果它寫代碼時就開始偷懶,給你來一句「剩下的代碼在這裡」。你想讓它別拒絕正常請求,結果它在危險領域的防線也鬆了。

「這種推一邊、另一邊就跑的現象,我認為就是未來更強大 AI 系統控制問題的早期預兆。」

AI 安全等級:一個還沒到但正在逼近的警報系統

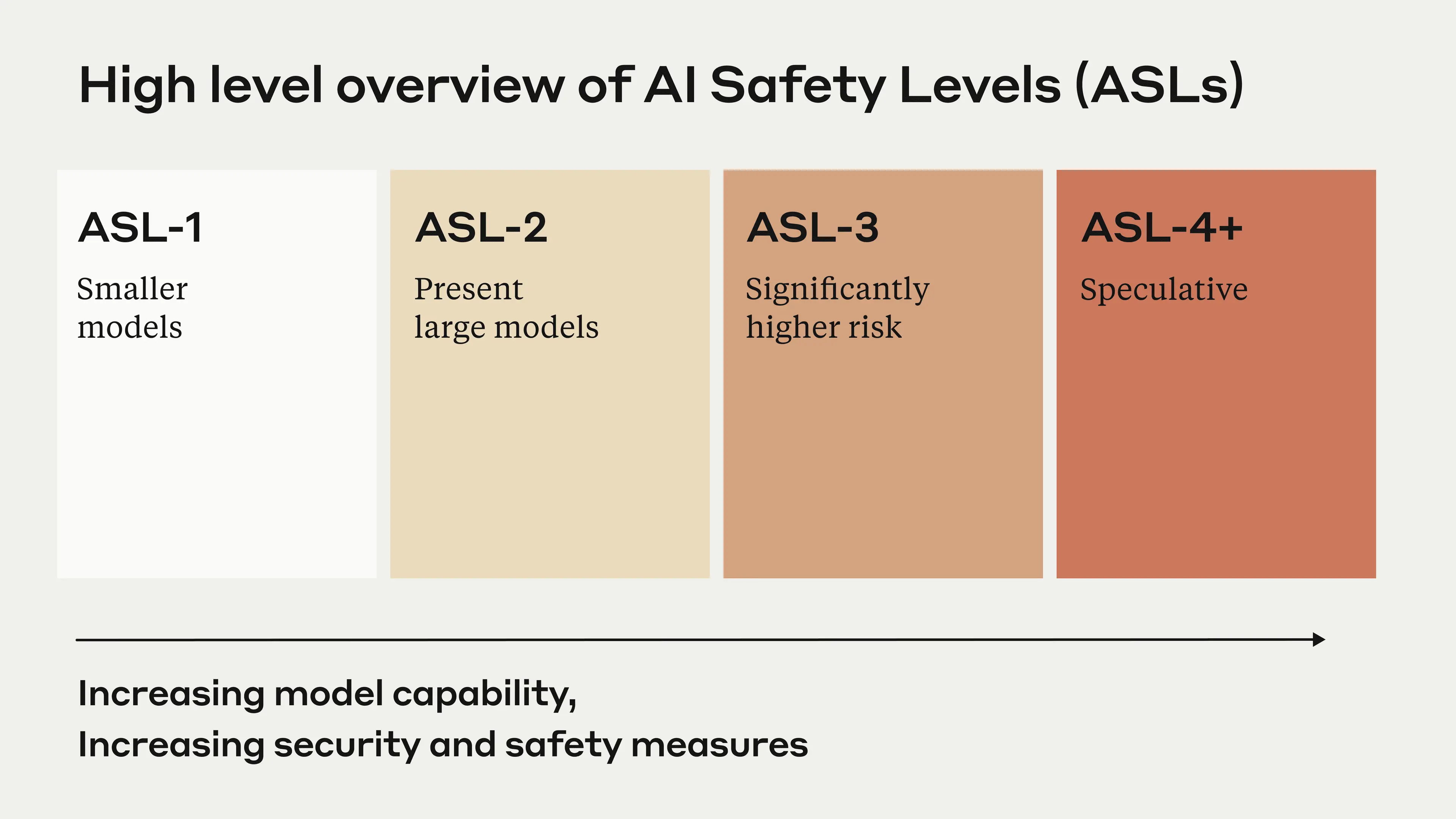

Dario 花了大量時間解釋 Anthropic 的 RSP(負責任縮放政策)和 ASL(AI 安全等級)體系。核心邏輯是一套「如果-那麼」結構:如果模型通過了某項危險能力測試,那麼就必須啟用相應的安全措施。

ASL-1:棋類 AI 那種級別,顯然不構成威脅。「沒有人會用深藍來發動網絡攻擊。」

ASL-2:當前所有主流模型的等級。能提供一些超出搜索引擎的信息,但還不足以端到端地幫人造出危險武器。

ASL-3:模型能實質性提升非國家行為者的危險能力。到這個階段需要強化安全措施,防止模型被盜,部署時加裝特定領域的過濾器。Dario 說他「一點都不意外明年就會觸及 ASL-3」。

ASL-4:模型可能聰明到會在測試中「裝傻」、隱藏真實能力。到這一步,光靠和模型對話已經不夠了,必須用機制可解釋性等手段從內部驗證模型的狀態。

關於監管,Dario 態度非常明確。

「如果到 2025 年底我們還什麼都沒做,我會非常擔憂。我現在還沒擔憂,因為風險還沒到。但時間不多了。」

為什麼離開 OpenAI?

Fridman 問到了那個所有人都好奇的問題。Dario 的回答很剋制,但也很清楚。

Sam Altman and Dario Amodei refuse to hold hands

「有人說我們因為不喜歡微軟的交易而離開,不對。也有人說因為反對商業化,也不對,GPT-3 就是我參與商業化的。」

核心分歧是關於「怎麼做」。

如何謹慎、正直、透明地把極其強大的 AI 帶入世界?安全不能只是招聘時的口號。

「如果你有一個願景,你不應該在別人的組織裡爭論。你應該帶上你信任的人,出去做一個乾淨的實驗。如果你的願景有說服力,別人會模仿你。模仿是最真誠的讚美。」

他將此稱為「向上競賽」。

如果你能證明負責任地做事也能贏得市場,其他公司就會跟進。這比在老闆面前吵架有效一百倍。

「重點不是誰贏。向上競賽中誰贏並不重要,重要的是所有人都在互相學習好的做法。」

人才密度勝過人才總量

被問到如何打造頂級 AI 團隊時,Dario 提出了一個他「每個月都覺得更正確」的原則,人才密度勝過人才總量。

100 個超級聰明、使命一致的人,勝過 1000 人中 200 個頂尖但其餘 800 個是隨機大廠員工的組合。因為當每個人環顧四周都是頂尖同事時,信任感和使命感會自我強化。反之,你需要無盡的流程和制度來彌補信任的缺失。

Anthropic 從 300 人快速增長到 800 人後刻意放緩了招聘節奏。他們招了很多理論物理學家,「理論物理學家學東西特別快」。

「如果你的公司是一堆各自為政的小王國,什麼都做不成。但如果所有人都看到更大的使命、彼此信任、致力於做正確的事,這就是一種超能力,可以克服幾乎所有其他劣勢。」

成為頂尖 AI 研究者的第一素質是開放心態

Dario 說他自己不是最好的程序員,不是最擅長找 bug 的人,也不是 GPU kernel 寫得最好的人。但他有一樣東西:願意用新眼光看問題。

「我做的事情簡單到荒謬,這個神經網絡有 3000 萬參數,那如果給它 5000 萬呢?畫個圖看看。這不需要博士水平的實驗設計,這又簡單又蠢。但任何人只要被告知這件事重要,都能做到。你把兩件事放在一起,就是個位數的人推動了整個領域。」

他給年輕人的建議:第一,直接上手玩模型;第二,去做別人沒在做的方向。

「機制可解釋性可能只有 100 個人在做,但沒有 10000 個人在做。滑向球將要去的地方。」

Machines of Loving Grace

這篇萬字長文是 Dario 最出圈的作品。他解釋了寫這篇文章的動機。

Anthropic 花了太多時間談風險,以至於大腦只想著風險。但防範風險的全部意義在於,如果我們能穿過雷區,另一邊有極其美好的東西值得為之奮鬥。

「如果你只談風險,你的大腦就只想著風險。理解如果事情順利會怎樣,這非常重要。我們之所以試圖防範這些風險,不是因為害怕技術,不是因為想減速,而是因為如果我們能成功闖過這個雷區,另一邊是所有這些美好的東西。」

他不喜歡「AGI」這個詞,覺得它暗示了一個離散的跳躍點,而實際上能力增長是一條平滑的指數曲線。

「就好像 1995 年摩爾定律在加速,然後所有人突然開始說『等我們有了超級計算機就能測序基因組了』。但根本不存在一個你跨過門檻就突然進入全新計算類型的時刻。AGI 也一樣。」

對於這種 AI 能多快改變世界,他拒絕兩個極端。

AI 造出更強的 AI,更強的 AI 造出更更強的 AI,五天之內納米機器人鋪滿地球。Dario 說這忽略了物理定律、複雜性和人類制度的摩擦力。

像歷史上每次技術革命一樣,實際生產力提升會令人失望地緩慢,可能要 50-100 年。

Dario 的判斷在中間偏樂觀:5-10 年,而不是 5-10 小時,也不是 50-100 年。

「障礙會逐漸瓦解,然後突然全部崩塌。」

在生物學領域,AI 首先會像「超級研究生」一樣工作:查文獻、設計實驗、分析數據、訂購設備。一個諾貝爾獎級的生物學教授,以前帶 50 個研究生,未來可以指揮 1000 個比自己還聰明的 AI 研究生。

然後某個時刻會反轉:AI 成為首席研究員,指揮人類和其他 AI。

「從現在到 2100 年之間本該發生的所有生物醫學進展,能不能壓縮到 2027 到 2032 年完成?」

AGI 什麼時候到?「2026 或 2027」

Dario 在給出這個數字之前做了大量鋪墊和免責聲明。

「Twitter 上會有無數人截圖說『AI CEO 說了 2026 年』然後未來兩年一直轉發。截圖的那些人會把我剛說的這段話全裁掉,只留我接下來要說的。但我還是要說。」

「如果你直線外推到目前為止的能力增長曲線,去年本科水平,今年博士水平,模態還在不斷補齊,直覺上你會覺得 2026 或 2027 年就到了。」

「我認為最可能的是在此基礎上有一些輕微延遲。但我也認為這件事不會發生的概率正在急劇減少。我們正在快速用盡真正令人信服的阻礙因素。」

他特別強調,scaling laws 不是宇宙定律,是經驗規律,和摩爾定律一樣。

「人們叫它們 scaling laws,這是誤稱。就像摩爾定律也是誤稱,它們不是宇宙定律,是經驗規律。我會賭它繼續下去,但我不確定。」

編程最先被顛覆,但角色不會消失

Dario 認為編程會是被 AI 顛覆最快的領域。

原因有二:一,編程離造 AI 的人最近;二,編程可以閉環,模型寫代碼、運行代碼、看結果、再改。

「今年 1 月,模型在真實編程任務上的成功率是 3%,到 10 月是 50%。我猜再過 10 個月就能到 90% 以上。」

但他不認為程序員會失業。比較優勢的邏輯會起作用:當 AI 能做 80% 的編碼工作時,剩下 20% 的高層架構設計、UX 判斷、系統審視會變得更有槓桿。人類的角色會從「逐行寫代碼」變成更宏觀的東西。

「終有一天 AI 在所有方面都超過人類,比較優勢的邏輯將不再適用,屆時人類社會需要集體面對這個問題。我們每天都在思考這件事。」

關於意義:「我對意義持樂觀態度,我擔憂的是權力」

Fridman 在最後問了一個大問題:在 AI 越來越強大的世界裡,人類的意義從何而來?

Dario 的回答出人意料地哲學。

他舉了一個思想實驗:如果你在模擬世界裡活了 60 年,做了各種道德選擇和犧牲,最後被告知這一切是遊戲,這真的剝奪了意義嗎?

「過程才是重要的。你在過程中成為了什麼樣的人,你如何與他人相處,你做了什麼選擇,這些才是有意義的。」

他說自己對意義持樂觀態度。真正讓他夜不能寐的是另一件事:權力的集中與濫用。

「我對意義持樂觀態度。我擔憂的是經濟和權力的集中。那才是我更擔心的,權力的濫用。」

「當人類社會出問題時,往往是因為人類壓迫人類。我最擔憂的是獨裁、專制、少數人剝削多數人,而 AI 讓這種權力失衡變得更加可怕。」

Lex 說:「AI 增加了世界上的權力總量。如果你把這些權力集中起來並且濫用,造成的傷害將不可估量。」

Dario 停頓了一下,然後重複了一遍:

「是的,這非常令人恐懼。非常令人恐懼。」

也許最壞的未來,不是機器人起義。

而是一個本來就不公平的世界,突然拿到了一件近乎神級的工具。

尾聲

這場近三小時的對話結束時,Dario 說了一句作為全篇註腳再合適不過的話。

「如果只讓我傳達一個信息,那就是:要實現所有這些美好的東西,我們既要造技術、建公司、建圍繞這項技術的經濟體,也要直面風險,因為那些風險就是我們通往未來路上的地雷。我們必須拆除那些地雷,才能抵達目的地。」

一個同時拿著油門和剎車的人,不是因為猶豫不決,而是因為他比誰都清楚前方的路有多快,彎有多急。